Fördert eine Vielzahl an menschlichen Charakteristika, dass wir uns sozial gegenüber Robotern verhalten oder reichen schon einige wenige spezifische menschliche Eigenschaften?

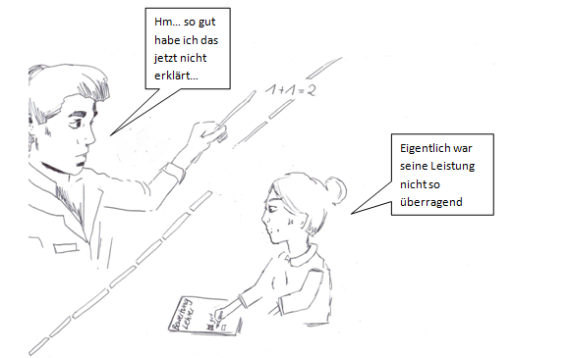

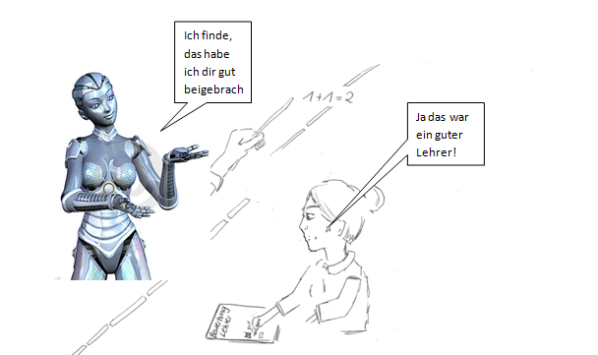

Nass et al. (Nass, Steuer, Henriksen, & Dryer, 1994; Smith, 1989) sowie auch andere Forscher haben in ihren Studien nachgewiesen, dass einige menschliche Eigenschaften in besonderem Maße soziales Verhalten hervorrufen. Sie haben zudem festgestellt, dass es möglich ist auch soziales Verhalten gegenüber Computern zu generieren, wenn ein PC genau diese Eigenschaften aufweist. In diesem Zusammenhang ist beispielsweise eine textbasierter Output (Brown, 1988; Turkle, 1984) – also eine Reaktion des PCs in Worten und das einfache Antworten als Zeichen von Interaktivität eine solche Eigenschaft (Rafaeli, 1990). Auch wenn ein PC die Rolle eines Menschen übernimmt ist das ein starker Reiz für Sozialverhalten der Technologie gegenüber (Cooley, 1966;

Mead, 1934).

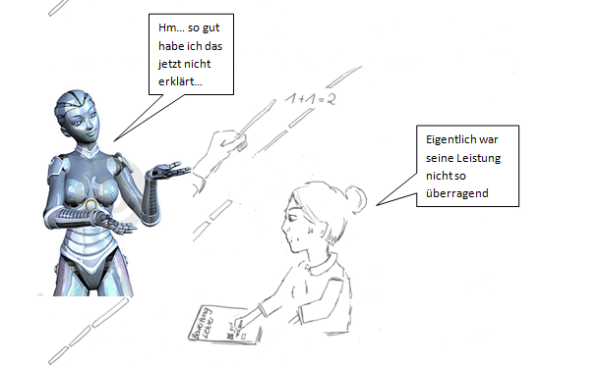

Sie bezeichnen dieses Verhalten auch als „Mindless behavior” (Nass & Moon, 2000) welches daraus resultiert, dass sich die Personen in solchen Situationen nur auf diese speziellen Eigenschaften als Reize konzentrieren und diese als Anhaltspunkte für ihr Verhalten benutzen. Dies führt aber auch dazu, dass andere Reize ausgeblendet werden wie beispielsweise jene Reize, die uns erkennen lassen, dass wir einer Technologie gegenüberstehen.

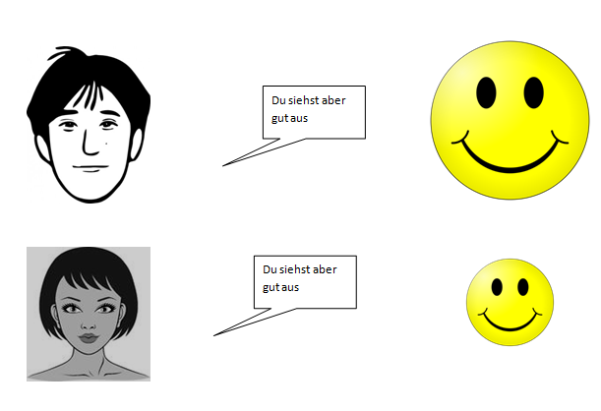

So wird auf der einen Seite behauptet, dass „(…)the more computers present characteristics that are associated with humans, the more likely they are to elicit social behavior.” (Nass & Moon, 2000, S. 24). Es gibt aber auch Forscher, die die Meinung vertreten, dass zu viele solcher menschlicher Eigenschaften auch dazu führen können, dass soziales Verhalten gehemmt wird. Scheinbare nicht relevante Kleinigkeiten wie einzelne etwas „unnatürliche“ Verhaltensweisen einer Technologie werden bei sehr menschenähnlichen Technologien dann besonders in den Fokus gerückt und soziales Verhalten verringert ( u.a. Nass & Gong, 1999;

Olive, 1997).

Im Kontext der HRI stellt sich so die Frage, ob sich Menschen sozial Verhalten wenn nur einige geringe menschliche Eigenschaften bei einem Roboter vorhanden sind oder dies eher der Fall ist, wenn Roboter dem Menschen in seinem Aussehen und seinen Fähigkeiten sehr nahe kommt. Wäre es möglich, dass Roboter eher als soziale Wesen eingestuft werden, wenn sie nur eine kleine Anzahl an menschlichen Eigenschaften aufweisen, weil diese dann in den Vordergrund treten? Kann es demnach auch sein, dass „Fehler“ oder „unnatürliche Verhaltensweisen“ eher wahrgenommen und als befremdlich eingestuft werden, wenn Roboter so aussehen und sich so verhalten wie echte menschliche Wesen?

Quelle:

Nass, C. & Moon, Y. (2000). Machines and mindlessness: Social responses to

computers. Journal of Social Issues, 56(1), 81-103.

Sekundär-Quellen:

Brown, B. (1988). The human-machine distinction as predicted by children’s para-social

interaction with toys. Unpublished doctoral dissertation, Stanford University, Stanford,

CA.

Cooley, C. H. (1966). Social process. Carbondale, IL: Southern Illinois University Press.

Mead, G. H. (1934). Mind, self, and society, from the standpoint of a social behaviorist. (C. W.

Morris, Ed.). Berkeley, CA: University of California Press

Nass, C. & Gong, L. (1999). Maximized modality or constrained consistency? Proceedings of the

AVSP 99 Conference, Santa Cruz, CA.

Nass, C., Steuer, J. S., Henriksen, L., & Dryer, D. C. (1994). Machines and social attributions:

Performance assessments of computers subsequent to „self-“ or „other-“ evaluations.

International Journal of Human-Computer Studies, 40, 543-559.

Olive, J. P. (1997). „The talking computer“: Text to speech synthesis. In D. Stork (ed.), HAL’s

legacy: 2001’s computer as dream and reality (pp. 101-130). Cambridge, MA: MIT. Chap. 6

Rafaeli, S. (1990). Interacting with media: Para-social interaction and real interaction. In B. D.

Ruben & L. A. Lievrouw (Eds.), Mediation, Information, and Communication:

Information and Behavior (Vol. 3). New Brunswick, NJ: Transaction (pp. 125-181).

Smith, E. E. (1989). Concepts and induction. Pp. 501-526 in M. I. Posner (Ed.), Foundations of

cognitive science. Cambridge, MA: MIT Press.

Turkle, S. (1984). The second self: Computers and the human spirit. New York: Simon and

Schuster.